設計すれば、

あとは自動で回る

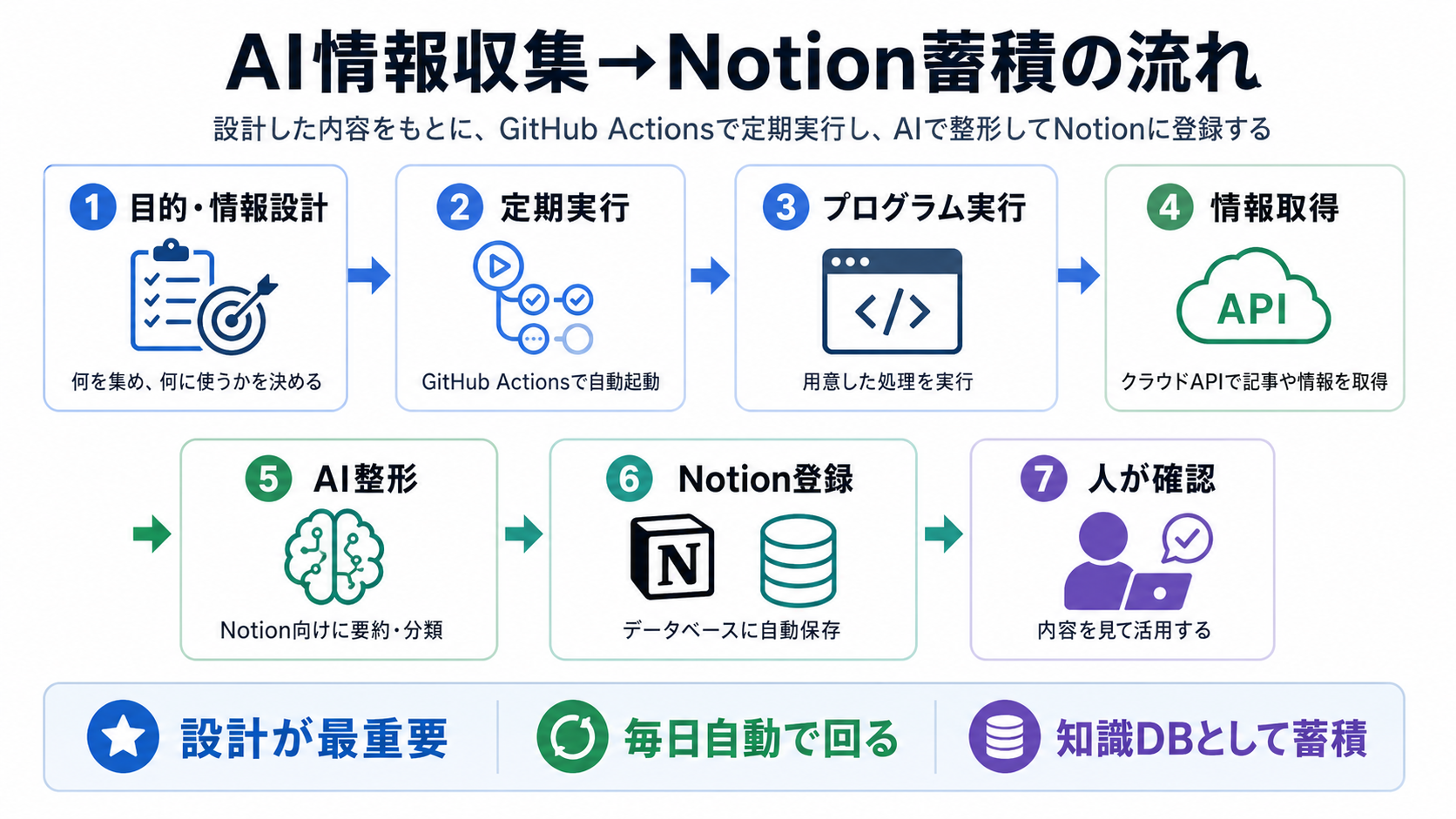

AI・マーケティング関連の情報収集を、GitHub Actions、Claude API、Notion APIで自動化した。重要なのは、最初に「何を取得し、何に使い、Notionにどう保存するか」を設計すること。そこが決まれば、あとはプログラムが毎日自動で動き、情報を取得し、AIが整形し、Notionに蓄積してくれる。

一番大事なのは、プログラムを書くことではない

この仕組みの主役は、PythonでもGitHub ActionsでもClaude APIでもない。最初に決めるべきなのは、「何のために、どんな情報を集めるのか」である。ここが曖昧なまま自動化すると、ただ情報が大量に溜まるだけで、後から使いにくいデータベースになってしまう。

先に実装から入る場合

- 何を集めるべきかが曖昧になる

- Notionに不要な情報が溜まりやすい

- 記事化や業務活用につながりにくい

- 自動化したのに、後から整理作業が発生する

先に情報設計する場合

- 取得対象と目的が明確になる

- Notionの項目設計と処理内容がつながる

- AIが出すべき要約・分類・気づきが決まる

- 登録後の確認・活用まで流れが作れる

自動化の本質は、作業を減らすことだけではない。

設計した判断基準どおりに、毎日データが育つ状態を作ること

ここに実務で使えるAI活用の価値がある。

全体の流れは、7ステップで考える

今回の仕組みは、定期実行を起点にして、情報取得、AI整形、Notion登録までを自動で行う。人間が毎日やる必要があるのは、最後に登録された内容を確認し、必要に応じて記事化・業務活用・再分析に回すことだけである。

Notionは、ただの保存先ではなく「受け皿」として設計する

Notionに登録するだけなら、タイトルとURLだけでも成立する。しかし、それでは後から活用しにくい。今回の仕組みでは、Notionを知識DBとして使うため、最初からAIの出力先として必要な項目を用意しておく。

- タイトルとURLだけが残る

- どの記事が重要だったか分からない

- 後から記事化候補を探す必要がある

- 情報は溜まるが、知識として使いにくい

- カテゴリ、要約、重要度を持たせる

- 気づきや示唆をAIに生成させる

- 記事化候補や活用先を判定できる

- 後からChatGPTに読み込ませて再分析できる

設計が決まれば、実装はClaude CodeやCodexに依頼しやすい

今回のような仕組みは、最初から人間がすべて手書きで作る必要はない。むしろ重要なのは、目的、取得対象、Notionの項目、実行タイミング、エラー時の確認方法を先に整理しておくことである。

その設計をもとに、Claude CodeやCodexに「この情報を取得し、この形式に整形し、このNotionデータベースへ登録し、GitHub Actionsで毎日実行するプログラムを作る」と依頼すれば、実装に落とし込みやすい。AIに丸投げするのではなく、設計と判断基準を人間が持ち、実装作業をAIに任せる形である。

APIキーやDB IDは、コードに直接書かない

このような自動化では、APIキーやNotionデータベースIDなどの秘匿情報をどう扱うかも重要である。ローカルでは.env、GitHub ActionsではRepository Secretsを使い、コード内に直接書かない形にする。

ローカル環境

- .envにAPIキーやNotion DB IDを保存する

- .gitignoreで.envを必ず除外する

- ローカル実行でNotion登録を確認する

- 成功後にGitHubへpushする

GitHub側

- Repository SecretsにAPIキーを登録する

- workflow内ではSecretsから環境変数を読む

- cronで毎日決まった時間に実行する

- エラー時はActionsログで原因を確認する

この仕組みの価値は、全自動で知識DBが育つことにある

この仕組みは、単なるニュース収集Botではない。毎日自動で情報を取得し、AIがNotion向けに整形し、データベースに蓄積することで、自分専用の知識DBが育っていく。人間は、すべての情報を毎日追いかけるのではなく、登録された情報を確認し、使うかどうかを判断すればよい。

低コストで回せるなら、個人でも十分に現実的である

現在の運用イメージでは、1日あたり約30件ほどのAI・マーケティング関連情報を取得し、Claude Haiku系のAPIで要約・分類・整形する。処理件数や出力量によって変動はあるが、月額500円前後で回せるなら、個人の情報収集基盤としてはかなり現実的である。

コストが低く収まりやすい理由

- 処理内容が短い要約・分類・整形中心である

- 長文生成よりも構造化処理が中心である

- Haiku系モデルは大量処理に使いやすい

- 人間の情報収集時間を考えると費用対効果が高い

運用時に見るべきこと

- 1日あたりの取得件数

- 1件あたりの入力テキスト量

- Notionに保存する出力項目数

- 月次のAPI利用料金とログ