AI Operation

AI活用で失敗しないための、

人間側の設計ルール

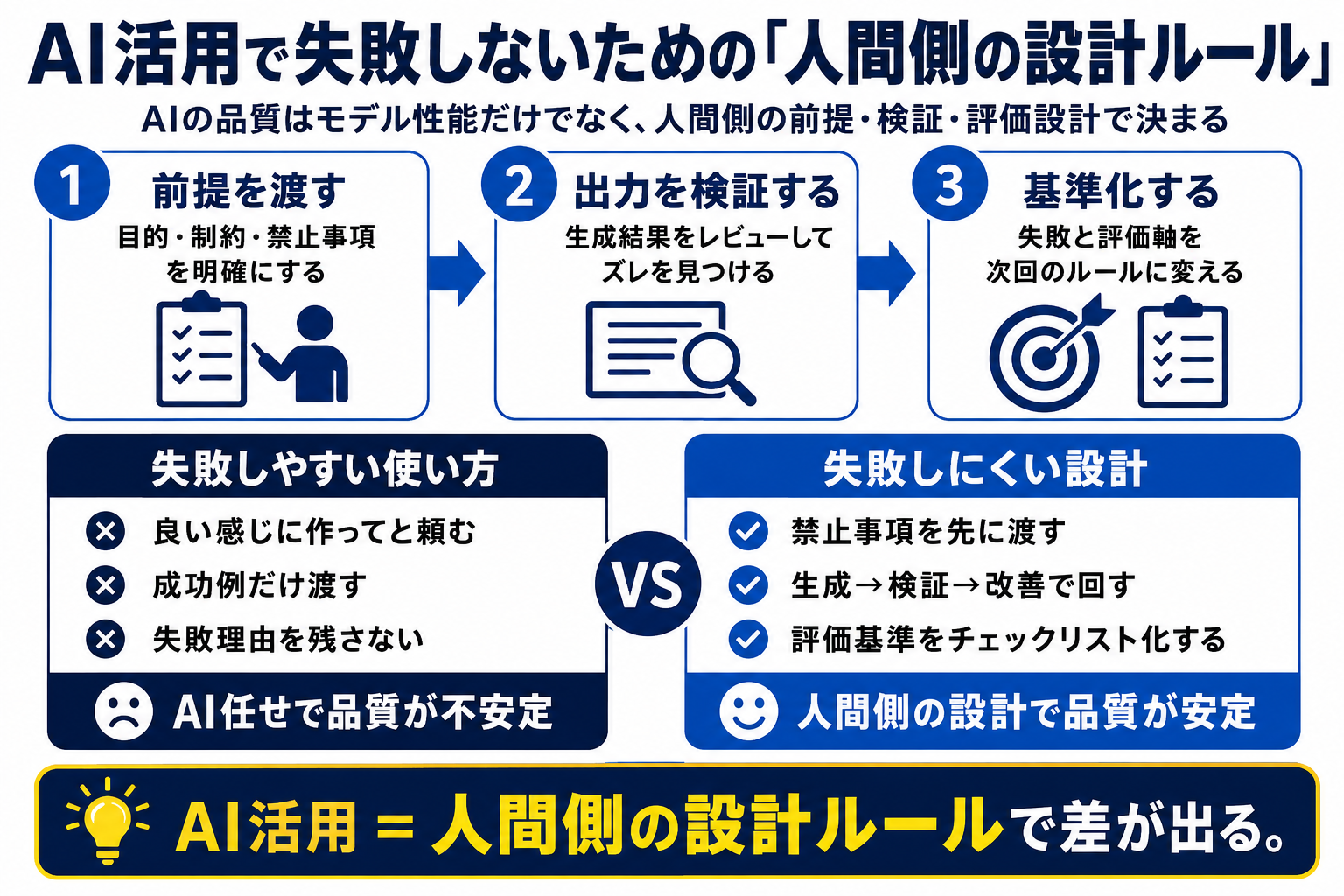

AIは賢い。しかし、賢いAIを使えば自然に良い成果物が出るわけではない。出力品質を決めるのは、モデル性能だけではなく、人間側がどのように前提を渡し、失敗を防ぎ、評価し、検証するかである。

AI活用の品質は、AIの賢さだけではなく、人間がどこまで失敗を設計できるかで決まる。

Section 01 — 失敗は繰り返される

LLMの失敗パターンは、かなり共通している

AIの出力ミスは毎回ランダムに起きるわけではない。余計な機能追加、既存仕様の破壊、曖昧な命名、根拠のない断定、検証不足。こうした失敗は、繰り返し現れる。

Before

弱い見方

- 良い感じに作ってと頼む

- 成功例だけを渡す

- レビューを後回しにする

- 失敗した理由を残さない

After

強い見方

- 禁止事項を先に渡す

- 負例を明示する

- 品質基準をチェックリスト化する

- 失敗を次の指示に変換する

Section 02 — AIは品質保証ツールではない

生成速度と品質保証は別物である

AIは作業を速くする。しかし、速く作れることと、正しいものができることは別である。サーベイ作成、コード生成、記事作成、分析レポート。どの領域でも、AIは初稿や候補を出すのは得意だが、品質保証を完全に任せることは危険である。

01

生成AIに候補や初稿を出させる。

02

検証人間が目的、前提、バイアス、抜け漏れを確認する。

03

基準化よかった点と失敗した点を次回のルールに変換する。

Section 03 — 評価コスト

AI時代のボトルネックは、作ることから評価することへ移る

AIによって生成コストが下がると、次に問題になるのは評価コストである。大量の案、コード、文章、調査結果が出てくるほど、それをどう評価し、どれを採用し、何を修正するかが重くなる。

Generate

感覚で頼む

- 良い感じに頼む

- 成功例だけ渡す

- レビューを後回し

- 失敗理由を残さない

Evaluate

ルールで頼む

- 禁止事項を渡す

- 負例を見せる

- 基準をチェック化

- 失敗を次に使う

Section 04 — 人間側の設計

AIを使いこなすとは、判断基準を外部化することである

AI活用で安定した成果を出すには、自分や組織の判断基準を明示する必要がある。何を優先するか、何を避けるか、どの形式で出すか、どの水準ならOKか。これらをルールとして残しておく。

AIに任せるほど、人間側の設計が重要になる。AIは作る速度を上げるが、何を良いとするかは人間側が定義しなければならない。

References — 参考・引用元

この記事で参照した元ネタ

以下の元ネタをもとに、複数の気づきを統合・再構成した。

- Claude コーディング能力を高める CLAUDE.md — GitHub

- AIによるサーベイ作成は人間による検証が必須 — Nielsen Norman Group

- GPT-5のゴブリン出現メカニズム — OpenAI

- AI評価が新しい計算ボトルネック化 — HuggingFace